Intel最新服务器CPU产品线以至强(Intel Xeon)系列为核心,2025-2025年重点推出了基于Intel 7制程工艺的第四代至强可扩展处理器(代号Sapphire Rapids),以及面向下一代数据的至强6系列(代号Granite Rapids)和至强6e系列(代号Granite Rapids-HBM),在性能、能效、AI算力及安全性方面实现全面升级,以下从核心架构、性能突破、应用场景及市场定位等维度展开分析。

核心架构与技术升级

第四代至强可扩展处理器采用Intel 7制程(10nm Enhanced SuperFin),最多可达60个核心,支持PCIe 5.0(最高80条通道)、DDR5-5600内存(八通道),并集成全新加速引擎,AMX(Advanced Matrix Extensions)指令集针对AI推理和训练优化,相比上一代性能提升达10倍;DL Boost技术通过VNNI指令加速深度学习,同时支持bfloat16(BF16)数据格式,提升大模型训练效率,处理器内置Intel QuickAssist技术(QAT),加密/解密性能提升2倍,满足金融、云服务等对安全性的高要求。

面向未来的至强6系列(预计2025年量产)进一步优化能效比,采用Intel 4制程工艺,核心数量增至64个,支持HBM3e高带宽内存(带宽超8TB/s),通过Chiplet(小芯片)设计提升良率和灵活性,至强6e系列则针对高密度计算场景,集成HBM内存,适用于AI训练、高性能计算(HPC)等领域,能效比提升达30%。

性能与能效表现

以第四代至强为例,旗舰型号Xeon Platinum 8490H(60核/120线程)基础频率2.0GHz,最大睿频可达3.2GHz,L3缓存达56MB,在SPEC CPU2025基准测试中,整数性能较第三代至强提升34%,浮点性能提升42%,能效方面,通过Intel Thread Director技术实现硬件调度,结合Intel Speed Select Technology(SST)动态调整功耗,典型热设计功耗(TDP)范围从150W至350W,数据中心级型号支持350W-500W超频模式。

下表对比第四代至强与第三代至强关键参数:

| 参数 | 第四代至强(Sapphire Rapids) | 第三代至强(Ice Lake) |

|---|---|---|

| 制程工艺 | Intel 7(10nm Enhanced SuperFin) | Intel 10nm SuperFin |

| 最大核心数 | 60 | 40 |

| PCIe通道数 | 80(PCIe 5.0) | 64(PCIe 4.0) |

| 内存支持 | DDR5-5600(八通道) | DDR4-3200(八通道) |

| AI性能(AMX) | 提升10倍 | 不支持 |

| 加密性能(QAT) | 2倍提升 | 1倍提升 |

应用场景与市场定位

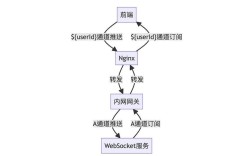

第四代至强已广泛应用于云服务(如AWS、Azure、阿里云)、企业级服务器、边缘计算及AI基础设施,在AI领域,其AMX加速引擎可高效运行大语言模型推理,例如在BERT模型推理中,吞吐量提升3倍;在HPC场景下,通过oneAPI统一编程模型,支持科学计算与AI混合负载,至强6系列则瞄准超算中心、AI训练集群等高端市场,HBM内存的加入将显著降低数据搬运延迟,适合LLM训练、基因组分析等场景。

相关问答FAQs

Q1:第四代至强相比上一代,实际应用中的AI性能提升如何?

A1:在AI推理场景下,第四代至强通过AMX指令集和DL Boost技术,针对INT8/INT4量化推理的吞吐量提升3-10倍,在ResNet-50图像分类模型中,每秒可处理更多图像帧数;在自然语言处理任务中,BERT模型的推理延迟降低40%,支持BF16格式后,大模型训练效率提升2倍以上,适合企业私有化AI部署。

Q2:至强6系列的HBM内存技术对服务器成本有何影响?

A2:HBM3e内存虽能提供超高带宽(8TB/s以上),但会增加单颗CPU成本约20%-30%,对于AI训练、HPC等对内存带宽敏感的场景,HBM可减少外部内存模块数量,降低主板设计和散热复杂度,长期来看,整体系统TCO(总拥有成本)可能因性能提升而优化,对于常规数据库、虚拟化等场景,DDR5版本的至强6仍是更具性价比的选择。