网站不被搜索引擎收录是许多网站所有者面临的问题,这种情况会直接导致网站无法获得自然流量,影响品牌曝光和业务发展,要解决这一问题,首先需要明确搜索引擎收录的基本逻辑,再从技术、内容、外部链接等多个维度排查原因,并采取针对性措施优化。

搜索引擎收录的核心逻辑是通过爬虫抓取网页内容,建立索引库,当用户搜索相关关键词时展示结果,如果网站不被收录,通常与爬虫无法抓取、内容质量不达标、网站存在技术障碍或违反搜索引擎规则有关,以下从具体问题出发,分析可能的原因及解决方法。

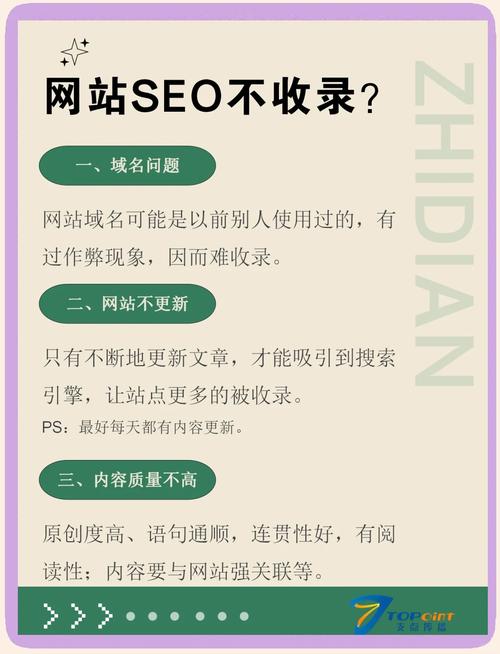

技术层面的问题是导致无法收录的首要因素,搜索引擎爬虫在抓取网站时,需要依赖清晰的网站结构和友好的技术配置,如果网站存在大量死链(404错误)、 robots.txt 文件配置错误、禁止爬虫抓取,或者存在抓取瓶颈(如服务器响应速度慢、网站加载时间过长),爬虫可能会放弃抓取,网站若采用 Flash、JavaScript 等搜索引擎难以识别的技术,也可能导致内容无法被解析,解决这些问题需要定期检查网站死链(可通过百度搜索资源平台、Google Search Console 等工具),确保 robots.txt 文件正确配置(避免误屏蔽重要目录),优化服务器性能(选择稳定的主机、启用缓存、压缩图片等),并尽量采用 HTML5 等搜索引擎友好的技术构建网站。 质量与原创性**是搜索引擎判断网页价值的关键,如果网站内容大量抄袭、重复,或与已有网页高度相似,搜索引擎可能会判定其为低质量内容,从而拒绝收录,内容过于单薄(如篇幅过短、缺乏深度)、频繁更新无关内容,或发布时间不规律,也会影响爬虫对网站的信任度,解决这一问题需要坚持原创,确保内容具有独特性和价值,针对用户需求提供深度解答;保持稳定的更新频率,例如每周发布2-3篇高质量文章,并围绕核心主题构建内容体系,形成主题集群,提升搜索引擎对网站专业度的认可。

网站权重与外部链接也是影响收录的重要因素,新网站由于缺乏历史数据和外部信任,可能需要更长时间才能被搜索引擎收录,如果网站缺乏高质量的外部链接(如来自权威网站的链接),或存在大量垃圾外链(如链接农场、低质量论坛链接),搜索引擎可能会降低对网站的信任度,导致收录缓慢,解决这一问题需要积极进行外部链接建设,例如通过行业合作、内容营销(如发布原创报告、案例研究)、参与高质量社区讨论等方式获取自然链接;避免购买黑链或参与链接交换群等违规操作,以免被搜索引擎惩罚。

搜索引擎惩罚是另一个不可忽视的原因,如果网站存在堆砌关键词、隐藏文字、桥页等黑帽SEO行为,或内容涉及违法、低俗信息,搜索引擎可能会对其进行惩罚,导致收录下降甚至完全不被收录,需要通过搜索引擎官方工具(如百度搜索资源平台的“申诉”功能)提交申诉,并彻底整改违规行为,等待搜索引擎重新审核。

以下是常见问题及解答:

FAQs

-

问:新网站上线后多久能被搜索引擎收录?

答:新网站收录时间因搜索引擎而异,通常为几天到几个月不等,百度对新网站的审核周期相对较短,部分优质网站可能在1-2周内被收录;Google 则可能需要1-3个月,为加快收录,可主动提交网站链接到搜索引擎官方平台(如百度搜索资源平台、Google Search Console),并生成XML网站地图,同时通过社交媒体、行业论坛等渠道推广网站,吸引爬虫抓取。 -

问:网站已提交收录但为何仍无结果?

答:提交收录仅表示“邀请”搜索引擎抓取,不代表一定会收录,若提交后长时间无结果,需排查技术问题(如 robots.txt 是否屏蔽、服务器是否正常)、内容质量(是否原创、是否有价值)及是否存在惩罚,新网站需积累一定权重和内容后,搜索引擎才会更频繁地抓取,建议持续优化并耐心等待。 (图片来源网络,侵删)

(图片来源网络,侵删)