Android 视频服务器是一种在 Android 设备上搭建的视频流媒体服务,主要用于实现视频的实时采集、编码、传输和播放,常见于安防监控、视频会议、在线教育、直播等场景,其核心功能是将 Android 设备(如手机、平板、嵌入式设备)作为视频源,通过局域网或互联网将视频流推送到服务器或直接分发给客户端,实现跨设备的视频共享和实时监控,以下从技术架构、实现流程、关键技术和应用场景等方面详细介绍 Android 视频服务器。

Android 视频服务器的技术架构

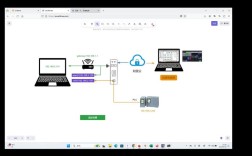

Android 视频服务器的架构通常分为四层:采集层、处理层、传输层和应用层,各层协同完成视频流的端到端处理。

采集层

采集层负责从 Android 设备的摄像头、麦克风或其他视频源获取原始视频数据,Android 系统提供了 Camera2 API(推荐,支持更高版本的设备)和 Camera API(旧版,兼容性较好)两种摄像头接口,可获取实时视频流,对于屏幕录制或外部设备输入,还可使用 MediaProjection API 或 USB Camera 接口。

- Camera2 API:支持多摄像头、手动控制(对焦、曝光、白平衡等)、4K 视频采集,适合专业场景。

- MediaProjection:用于录制屏幕或应用内画面,常用于直播或远程演示。

处理层

处理层对采集到的原始视频数据进行编码、封装和优化,以减少传输带宽并提升播放效率。

- 编码:Android 支持

MediaCodecAPI 进行硬件编码(如 H.264、H.265/HEVC),相比软件编码,硬件编码能显著降低 CPU 占用和功耗,H.264 兼容性好,H.265 压缩效率更高但需要解码端支持。 - 封装:将编码后的视频数据封装为标准格式(如 MP4、FLV、RTSP),便于传输和解析。

- 滤镜/特效:可通过

OpenGL ES或MediaEffects添加实时滤镜、水印或美颜效果,增强用户体验。

传输层

传输层负责将处理后的视频流通过网络发送到客户端或服务器,常见的传输协议包括:

- RTSP(Real-Time Streaming Protocol):基于 TCP,适合实时点播和直播,支持多客户端拉流,但延迟较高(2-5 秒)。

- RTMP(Real-Time Messaging Protocol):基于 TCP,常用于直播推流(如配合 Nginx-RTMP 服务器),延迟较低(1-3 秒),但需专用服务器支持。

- HLS(HTTP Live Streaming):基于 HTTP,通过分段 TS 文件和 M3U8 播放列表实现直播,兼容性好(支持移动端和 Web 端),但延迟较高(5-10 秒)。

- WebRTC:基于 UDP,支持低延迟(<1 秒)、双向实时通信,适合视频会议和远程控制,但技术复杂度高,需 STUN/TURN 服务器穿透 NAT。

应用层

应用层提供用户交互界面和管理功能,如视频预览、推流控制、用户权限管理、日志记录等,可通过 Android 的 Activity/Fragment 实现前端界面,结合后端 API(如 RESTful API)实现远程管理。

Android 视频服务器的实现流程

以“Android 设备作为 RTSP 服务器,客户端通过 RTSP 拉流播放”为例,实现流程如下:

- 初始化摄像头:使用

Camera2 API打开摄像头,配置分辨率(如 1920×1080)、帧率(如 30fps)和格式(如 YUV_420_888)。 - 设置编码器:通过

MediaCodec创建 H.264 硬件编码器,配置编码参数(比特率、关键帧间隔等),将摄像头输出的 YUV 数据编码为 H.264 码流。 - 封装 RTSP 流:使用开源库(如

librtmp或live555)将 H.264 码流封装为 RTSP 格式,并绑定到指定端口(如 554)。 - 启动服务:在 Android 后台服务(

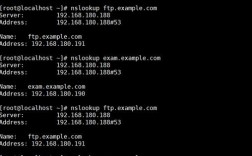

Service)中运行推流逻辑,确保设备锁屏或应用退推流时仍能持续传输视频。 - 客户端拉流:客户端(如 VLC、Android 播放器)通过 RTSP 协议(如

rtsp://[设备IP]:554/live)拉取视频流并解码播放。

关键技术点与优化方向

硬件编码与性能优化

- 硬件编码优先:

MediaCodec的硬件编码模式(MediaCodec.createEncoderByType("video/avc"))可大幅降低 CPU 占用,避免掉帧。 - 多线程处理:将视频采集、编码、传输放在不同线程(如

HandlerThread或ThreadPoolExecutor),避免阻塞主线程导致界面卡顿。 - 分辨率自适应:根据网络状况动态调整分辨率(如 Wi-Fi 下 1080p,4G 下 720p),通过

MediaCodec的configure()方法重新配置参数。

网络传输优化

- 协议选择:低延迟场景选 WebRTC 或 RTMP,兼容性场景选 HLS 或 RTSP。

- 带宽控制:通过

Socket或RTP协议的 QoS 机制(如丢包重传、码率动态调整)减少网络波动影响。 - NAT 穿透:若设备处于内网,需配合 STUN/TURN 服务器(如

PJSIP)实现公网访问,或通过端口映射(路由器配置)直接暴露 RTSP 服务。

稳定性保障

- 异常处理:捕获摄像头权限被拒绝、编码器创建失败、网络中断等异常,通过

try-catch和重连机制(如 Exponential Backoff)恢复服务。 - 电源管理:在

AndroidManifest.xml中声明WAKE_LOCK权限,防止设备休眠导致推流中断;使用Foreground Service提升服务优先级。

典型应用场景

| 场景 | 需求特点 | 技术方案 |

|---|---|---|

| 安防监控 | 7×24 小时稳定推流、低延迟、移动侦测 | 使用 Camera2 API + H.264 硬件编码 + RTSP 传输,结合 Motion Detection 算法触发告警 |

| 直播推流 | 低延迟、高并发、支持美颜/滤镜 | MediaProjection(屏幕录制)+ MediaCodec 编码 + RTMP 推流至 Nginx-RTMP 服务器 |

| 视频会议 | 双向实时通信、低延迟、跨平台(Android/iOS/Web) | WebRTC 技术栈,实现点对点音视频传输,辅以信令服务器(如 Socket.io)管理会话 |

| 远程控制 | 实时预览、远程操控(如云台控制)、低延迟 | RTSP 传输视频 + TCP Socket 传输控制指令,支持自定义协议扩展 |

相关问答 FAQs

Q1:Android 视频服务器如何解决设备休眠导致的推流中断问题?

A1:可通过以下方式解决:

- 声明 WakeLock 权限:在

AndroidManifest.xml中添加<uses-permission android:name="android.permission.WAKE_LOCK" />,并在代码中通过PowerManager.WakeLock保持 CPU 唤醒; - 使用 Foreground Service:将推流服务设置为前台服务(

startForeground()),并显示通知,避免系统回收后台进程; - 禁用电池优化:引导用户在系统设置中为应用关闭“电池优化”,或通过

REQUEST_IGNORE_BATTERY_OPTIMIZATIONS权限申请忽略电池限制(需 Android 6.0+)。

Q2:如何在 Android 视频服务器中实现多客户端同时拉流?

A2:可通过以下步骤实现:

- 选择支持多播的协议:如 RTSP over UDP(需组播地址支持)或 RTMP 服务器(如 Nginx-RTMP)分发流;

- 管理客户端连接:在 Android 服务器端维护一个客户端列表(如

ConcurrentHashMap),记录每个客户端的 RTSP 请求和 Socket 连接; - 数据分发:将编码后的视频数据通过多播(

MulticastSocket)或广播(BroadcastSocket)发送,或为每个客户端创建独立的线程推流(适用于 RTMP 协议)。

使用live555库时,可通过RTSPServer类管理多个客户端连接,每个客户端拉流时创建独立的RTSPClient实例处理请求。