Linux C 服务器框架是构建高性能、高可靠性网络服务的基础,它结合了Linux操作系统的底层特性和C语言的高效性,为开发者提供了灵活且强大的开发环境,这类框架通常采用事件驱动、非阻塞I/O、多进程或多线程等架构模式,以应对高并发、大数据量的网络请求场景,以下从核心组件、设计模式、关键技术及实践案例等方面展开详细说明。

核心组件与架构设计

一个典型的Linux C服务器框架包含以下核心模块:网络监听、事件分发、协议解析、业务逻辑处理及资源管理,其架构设计直接影响服务器的性能和扩展性,常见架构包括单进程循环、多进程、多线程及Reactor/Proactor模式。

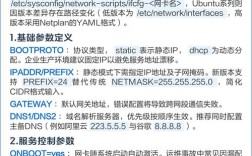

-

网络监听模块

基于Socket API实现,通过bind()绑定指定端口,listen()进入监听状态,再通过accept()接收客户端连接,为提高并发性能,通常采用非阻塞Socket配合select、poll或epoll等多路复用技术。epoll在Linux下通过事件通知机制实现高效I/O multiplexing,适合处理大量并发连接。 -

事件分发模块

事件分发是服务器的核心,负责将I/O事件(如连接请求、数据到达)分发给对应的处理函数,Reactor模式是Linux C服务器中广泛使用的设计,它将事件注册、检测和分发分离,通过事件循环(Event Loop)实现高效调度,以epoll为例,其工作流程包括:- 创建

epoll实例:epoll_create() - 注册事件:

epoll_ctl()(添加/修改/删除监听事件) - 等待事件:

epoll_wait()(阻塞等待事件发生,返回活跃事件列表)

- 创建

-

协议解析与业务处理

协议解析模块负责将网络字节流转换为应用层数据(如HTTP请求、自定义二进制协议),业务处理模块则根据协议内容执行具体逻辑,为避免阻塞事件循环,解析和处理需采用非阻塞方式,或通过线程池分离I/O与计算任务。 (图片来源网络,侵删)

(图片来源网络,侵删) -

资源管理

包括内存管理(如内存池技术减少频繁malloc/free)、连接管理(如连接超时检测、心跳机制)及错误处理(如信号捕获、优雅退出),通过SIGCHLD信号回收子进程资源,避免僵尸进程。

关键技术实现

-

非阻塞I/O与多路复用

非阻塞I/O通过设置Socket为O_NONBLOCK模式,确保读写操作不会阻塞进程,结合epoll的ET(Edge Triggered)或LT(Level Triggered)模式,可进一步提升效率,ET模式仅在状态变化时通知事件,减少系统调用次数,但需确保一次性处理完所有数据。 -

多进程与多线程模型

- 多进程模型:通过

fork()创建子进程,每个进程独立处理连接,利用多核CPU优势,典型实现如Apache的Prefork MPM,但进程间通信(IPC)开销较大。 - 多线程模型:主线程负责监听和接受连接,工作线程通过任务队列分配任务,需注意线程同步(互斥锁、条件变量)及数据竞争问题。

- 混合模型:如Nginx的Master-Worker模式,Master进程管理Worker进程,Worker进程采用多线程+事件循环处理请求。

- 多进程模型:通过

-

内存优化

服务器频繁进行内存分配和释放,易导致内存碎片,可通过内存池技术预分配内存块,如固定大小块分配器或slab分配器,减少系统调用开销,Nginx的ngx_pool_t实现了高效的内存池管理。 -

高性能数据结构

选择合适的数据结构对性能至关重要,使用跳表(Skip List)替代平衡树实现高效的范围查询,或采用哈希表(如uthash库)快速查找连接信息。

实践案例:基于epoll的简单Reactor框架

以下是一个简化的Reactor框架实现流程,展示核心逻辑:

#include <sys/epoll.h>

#include <unistd.h>

#include <fcntl.h>

#define MAX_EVENTS 1024

void set_nonblocking(int fd) {

int flags = fcntl(fd, F_GETFL, 0);

fcntl(fd, F_SETFL, flags | O_NONBLOCK);

}

int main() {

int listen_fd = socket(AF_INET, SOCK_STREAM, 0);

set_nonblocking(listen_fd);

struct sockaddr_in addr;

bind(listen_fd, (struct sockaddr*)&addr, sizeof(addr));

listen(listen_fd, SOMAXCONN);

int epoll_fd = epoll_create1(0);

struct epoll_event ev, events[MAX_EVENTS];

ev.events = EPOLLIN | EPOLLET;

ev.data.fd = listen_fd;

epoll_ctl(epoll_fd, EPOLL_CTL_ADD, listen_fd, &ev);

while (1) {

int n = epoll_wait(epoll_fd, events, MAX_EVENTS, -1);

for (int i = 0; i < n; i++) {

if (events[i].data.fd == listen_fd) {

int conn_fd = accept(listen_fd, NULL, NULL);

set_nonblocking(conn_fd);

struct epoll_event ev;

ev.events = EPOLLIN | EPOLLET;

ev.data.fd = conn_fd;

epoll_ctl(epoll_fd, EPOLL_CTL_ADD, conn_fd, &ev);

} else {

// 处理客户端数据

char buf[1024];

int len = read(events[i].data.fd, buf, sizeof(buf));

if (len <= 0) {

close(events[i].data.fd);

epoll_ctl(epoll_fd, EPOLL_CTL_DEL, events[i].data.fd, NULL);

} else {

// 业务逻辑处理

}

}

}

}

return 0;

}

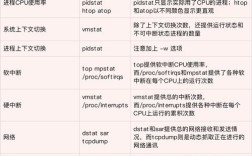

性能优化与常见问题

-

性能瓶颈

- CPU密集型任务:避免在事件循环中执行复杂计算,可通过线程池转移任务。

- I/O密集型任务:使用

O_DIRECT绕过page cache,或采用异步I/O(io_uring)减少等待时间。

-

常见问题

- 惊群效应:多进程/线程同时

accept()同一监听Socket,导致资源浪费,可通过SO_REUSEPORT(Linux 3.9+)或让单进程accept()解决。 - 文件描述符泄漏:未及时关闭

epoll实例或连接Socket,需在错误处理中确保资源释放。

- 惊群效应:多进程/线程同时

相关问答FAQs

Q1: Linux C服务器中,Reactor模式和Proactor模式有什么区别?

A: Reactor模式采用同步I/O,由应用程序负责读写数据,事件循环仅通知事件发生;Proactor模式采用异步I/O,操作系统直接完成数据读写并通知应用程序,Linux下可通过io_uring实现Proactor模式,但Reactor模式(基于epoll)更成熟且应用广泛。

Q2: 如何在高并发场景下避免服务器崩溃?

A: 可通过以下措施提升稳定性:1)使用资源限制(如setrlimit)防止内存耗尽;2)实现优雅退出机制(如捕获SIGTERM信号,完成当前请求后关闭连接);3)引入熔断机制(如限制单位时间请求数),避免雪崩效应;4)定期进行压力测试,优化性能瓶颈。